Seq2Seq (Sequence-to-Sequence) là mô hình AI giúp biến một chuỗi dữ liệu thành chuỗi khác dễ hiểu. Ví dụ như dịch câu tiếng Anh sang tiếng Việt hoặc tóm tắt văn bản dài thành ngắn gọn. Cùng Nhân Hòa khám phá Seq2Seq là gì và tại sao trở thành nền tảng quan trọng trong các hệ thống AI như dịch tự động, chatbot và xử lý ngôn ngữ tự nhiên hiện nay.

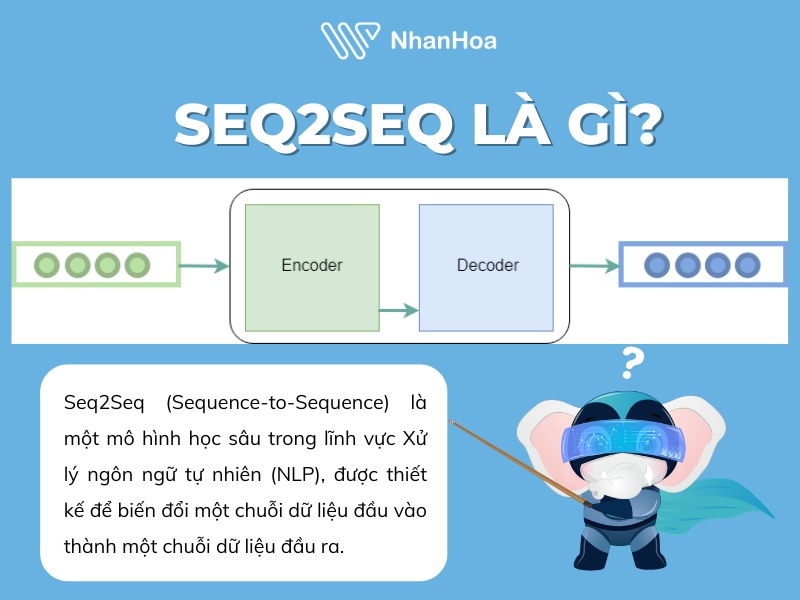

1. Seq2Seq là gì?

Seq2Seq (Sequence-to-Sequence) là một mô hình học sâu trong lĩnh vực Xử lý ngôn ngữ tự nhiên (NLP), được thiết kế để biến đổi một chuỗi dữ liệu đầu vào thành một chuỗi dữ liệu đầu ra.

Seq2Seq giống như một “máy dịch”:

-

Input: một chuỗi (câu, đoạn văn, âm thanh…)

-

Output: một chuỗi mới (có thể khác độ dài và ý nghĩa tương đương)

Ví dụ:

-

“I love AI” → “Tôi yêu AI”

-

Một đoạn văn dài → bản tóm tắt ngắn

>>> Xem thêm: CoAP là gì? CoAP - Lựa chọn thông minh cho IoT thời đại mới

2. Mô hình Seq2Seq hoạt động như thế nào?

Seq2Seq hoạt động theo cơ chế mã hóa → giải mã, tức là biến một chuỗi đầu vào thành chuỗi đầu ra thông qua 2 thành phần chính:

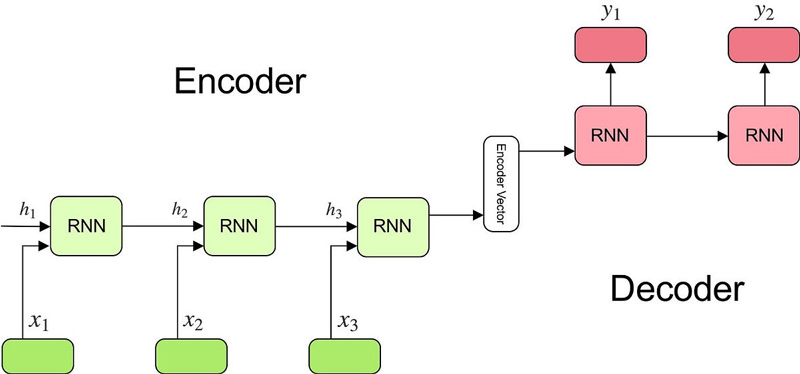

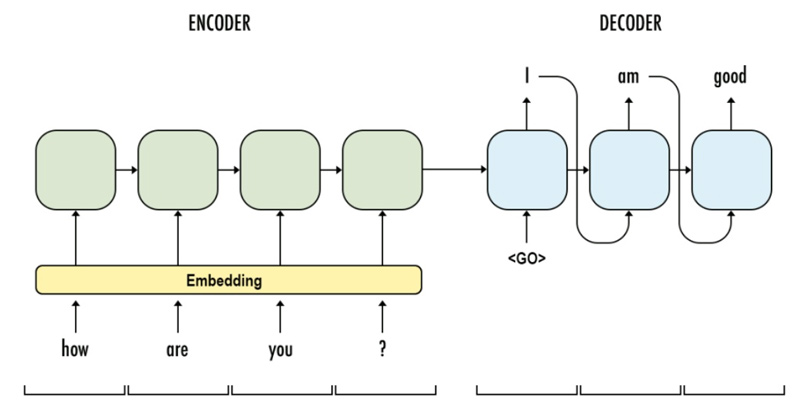

2.1. Encoder (bộ mã hóa)

-

Encoder đọc chuỗi input từng token (từng từ)

-

Mỗi bước sẽ cập nhật trạng thái (hidden state)

-

Sau khi xử lý xong toàn bộ câu, encoder tạo ra một vector ngữ cảnh (context vector) - đây là phần quan trọng nhất, vì nó tóm tắt toàn bộ ý nghĩa của câu đầu vào.

>>> Có thể hiểu đơn giản: Encoder giống như “người đọc”, đọc xong câu và ghi nhớ nội dung chính trong đầu.

2.2. Decoder (bộ giải mã)

Decoder nhận context vector từ encoder và dùng nó làm “điểm bắt đầu” để sinh ra chuỗi đầu ra. Quá trình này diễn ra từng bước (từng token), không tạo ra toàn bộ câu cùng lúc.

Cụ thể:

-

Ở mỗi bước, decoder sẽ:

-

Sinh ra một từ tiếp theo trong câu đầu ra

-

Cập nhật lại trạng thái ẩn của chính nó

-

Sử dụng kết quả vừa tạo để dự đoán bước tiếp theo

>>> Có thể hiểu: Decoder giống như “người viết”, dựa vào ý đã hiểu để viết lại câu mới từng từ một.

Trong thực tế, chỉ dùng context vector duy nhất sẽ khiến mô hình khó nhớ thông tin khi câu quá dài. Vì vậy, cơ chế Attention được thêm vào để giúp decoder tập trung vào những phần quan trọng của câu đầu vào tại từng bước sinh từ, không cần “nhớ tất cả trong một vector duy nhất”. Theo nghiên cứu thực tế cho thấy thêm Attention giúp tăng hiệu suất dự đoán trung bình ~8% (Nguồn: Sciencedirect)

>>> Xem thêm: MQTT là gì? Vì sao các hệ thống IoT đều cần MQTT?

3. Ưu nhược điểm khi sử dụng mô hình Sequence-to-Sequence

3.1. Ưu điểm của Seq2Seq

Seq2Seq là một mô hình mạnh mẽ trong NLP nhờ khả năng:

-

Linh hoạt với độ dài chuỗi: Seq2Seq có thể xử lý cả chuỗi ngắn và dài mà không cần cố định kích thước đầu vào/đầu ra, rất phù hợp với các bài toán như dịch câu, tóm tắt văn bản hay hội thoại.

-

Hiểu ngữ cảnh tốt hơn: Mô hình có khả năng học các mối quan hệ phức tạp trong toàn bộ câu, giúp nắm bắt đúng ý nghĩa thay vì chỉ dựa vào từng từ riêng lẻ.

-

Học trực tiếp end-to-end: Seq2Seq ánh xạ từ đầu vào sang đầu ra trong một mô hình duy nhất, không cần xử lý trung gian hay thiết kế đặc trưng thủ công → giảm công sức và tăng hiệu quả huấn luyện.

-

Mô hình hóa ngôn ngữ mạnh mẽ: Có thể học xác suất của chuỗi đầu ra, từ đó áp dụng tốt trong các bài toán như nhận dạng giọng nói, chuyển văn bản thành giọng nói hoặc OCR.

-

Tạo nội dung tự động: Seq2Seq không chỉ phân tích mà còn sinh ra chuỗi mới như tóm tắt văn bản, sinh phản hồi chatbot hoặc viết lại nội dung, rất hữu ích trong các hệ thống AI hiện đại.

3.2. Nhược điểm của Seq2Seq

Seq2Seq cũng tồn tại một số nhược điểm, đặc biệt so với các kiến trúc AI hiện đại hơn:

-

Tốn tài nguyên tính toán: Việc huấn luyện Seq2Seq, đặc biệt khi dùng LSTM hoặc GRU, yêu cầu phần cứng mạnh, dữ liệu lớn và thời gian train khá lâu → chi phí cao.

-

Khó xử lý chuỗi quá dài: Dù được thiết kế cho dữ liệu tuần tự, Seq2Seq vẫn gặp vấn đề “gradient biến mất”, khiến việc ghi nhớ thông tin xa trong chuỗi dài bị hạn chế (kể cả khi có attention).

-

Phụ thuộc mạnh vào dữ liệu: Mô hình cần tập dữ liệu đủ lớn và chất lượng tốt. Nếu dữ liệu ít hoặc không đa dạng, rất dễ bị overfitting và giảm khả năng áp dụng thực tế.

-

Khó tối ưu mô hình: Hiệu suất Seq2Seq phụ thuộc nhiều vào kiến trúc và siêu tham số (số lớp, kích thước hidden, optimizer…). Việc tinh chỉnh đòi hỏi kinh nghiệm và mất nhiều thời gian thử nghiệm.

-

Bị cạnh tranh bởi Transformer: Các mô hình hiện đại như Transformer, BERT hay GPT thường cho hiệu quả tốt hơn nhờ xử lý song song và học ngữ cảnh dài tốt hơn → khiến Seq2Seq truyền thống dần ít được ưu tiên.

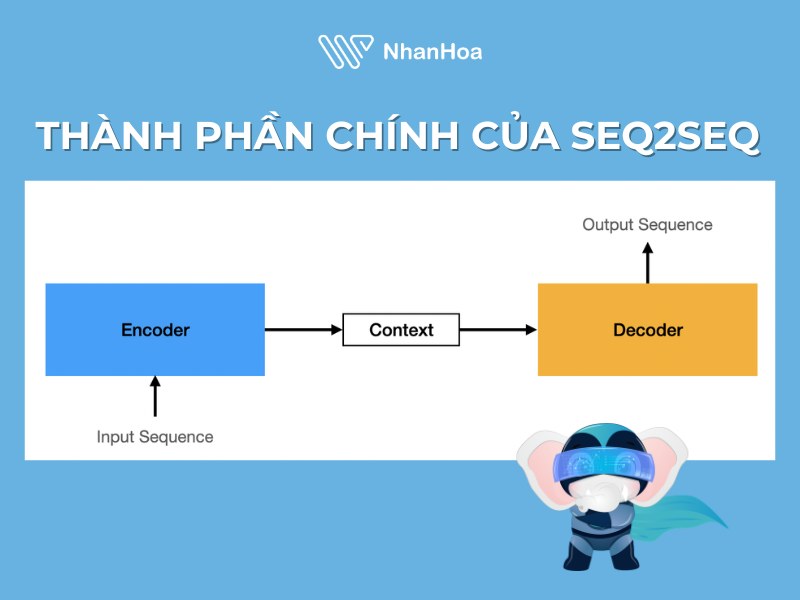

4. Seq2Seq gồm những thành phần chính nào?

Seq2Seq hoạt động dựa trên sự kết hợp giữa encoder - decoder và các cơ chế attention, gồm các thành phần chính như:

-

Bộ mã hóa (Encoder): Nhận chuỗi đầu vào và chuyển thành dạng biểu diễn số (vector). Nhờ các lớp attention và mạng nơ-ron, encoder giúp mô hình “hiểu” toàn bộ nội dung và ngữ cảnh của câu.

-

Bộ giải mã (Decoder): Dựa trên thông tin từ encoder để tạo ra chuỗi đầu ra theo từng bước (từng từ/token). Decoder vừa sinh nội dung, vừa “nhìn lại” đầu vào để đảm bảo đúng ngữ nghĩa.

-

Cơ chế Attention (Self-Attention): Giúp mô hình tập trung vào những phần quan trọng của câu thay vì xử lý đều tất cả. Nhờ đó, Seq2Seq hiểu ngữ cảnh tốt hơn, đặc biệt trong các câu dài.

-

Mã hóa vị trí (Positional Encoding): Bổ sung thông tin về thứ tự các từ trong câu (vì mô hình không tự biết vị trí). Điều này giúp phân biệt ý nghĩa khi thay đổi trật tự từ.

-

Multi-Head Attention: Cho phép mô hình “chú ý” theo nhiều góc nhìn khác nhau cùng lúc, từ đó học được nhiều mối quan hệ phức tạp trong câu.

-

Mạng nơ-ron truyền thẳng (Feed-Forward Network): Xử lý sâu hơn các thông tin đã được attention, giúp mô hình học các đặc trưng phức tạp và nâng cao độ chính xác.

5. Ứng dụng của mô hình seq to seq là gì?

Ứng dụng của mô hình Seq2Seq (Sequence-to-Sequence):

-

Dịch máy (Machine Translation): Đây là ứng dụng phổ biến nhất, giúp chuyển đổi văn bản từ ngôn ngữ này sang ngôn ngữ khác (ví dụ: Anh → Việt) với độ chính xác ngày càng cao.

-

Tóm tắt văn bản (Text Summarization): Seq2Seq có thể rút gọn tài liệu dài thành bản tóm tắt ngắn gọn, giữ lại ý chính và loại bỏ thông tin dư thừa.

-

Nhận diện giọng nói (Speech Recognition): Chuyển đổi âm thanh (giọng nói) thành văn bản, được ứng dụng trong trợ lý ảo, nhập liệu bằng giọng nói.

-

Chatbot & AI hội thoại: Seq2Seq giúp tạo ra phản hồi tự nhiên trong các cuộc trò chuyện, là nền tảng cho chatbot và hệ thống chăm sóc khách hàng tự động.

-

Tạo mô tả hình ảnh (Image Captioning): Kết hợp với CNN, mô hình có thể “nhìn” hình ảnh và tạo ra câu mô tả phù hợp bằng ngôn ngữ tự nhiên.

-

Mô tả video (Video Captioning): Tương tự hình ảnh nhưng áp dụng cho video, giúp tạo nội dung mô tả các hành động và bối cảnh theo thời gian.

-

Dự đoán chuỗi thời gian (Time Series): Dùng để dự báo dữ liệu tương lai dựa trên dữ liệu quá khứ, như giá cổ phiếu, thời tiết hoặc nhu cầu thị trường.

-

Sinh mã lập trình (Code Generation): Có thể tạo ra đoạn code từ mô tả ngôn ngữ tự nhiên, hỗ trợ lập trình viên trong quá trình phát triển phần mềm.

Lời khuyên từ Đội ngũ Kỹ thuật AI & Cloud tại Nhân Hòa:

Việc xây dựng và huấn luyện (training) các mô hình seq to seq hay Transformer yêu cầu khả năng xử lý ma trận khổng lồ. Nếu chạy trên CPU thông thường, quá trình này có thể mất hàng tuần.

Để tối ưu hóa, các kỹ sư AI (AI Engineer) bắt buộc phải sử dụng GPU (Graphics Processing Unit) với lượng VRAM lớn và hàng ngàn CUDA Cores. Thay vì đầu tư hàng trăm triệu đồng để mua server vật lý, giải pháp tối ưu ROI nhất cho doanh nghiệp hiện nay là thuê Cloud Server hoặc GPU Server chuyên dụng. Hạ tầng tại Nhân Hòa đảm bảo Uptime 99.9%, băng thông lớn, giúp quá trình train model diễn ra liên tục, không gián đoạn và dễ dàng mở rộng (scale-up) khi dữ liệu phình to.

6. FAQs liên quan đến Seq2Seq

6.1. Seq2Seq có phải transformer không?

Không. Transformer là kiến trúc hiện đại hơn, thay thế những hạn chế của Seq2Seq truyền thống.

6.2. Mô hình Seq2Seq có dùng được nhiều ngôn ngữ không?

CÓ. Seq2Seq hoàn toàn có thể xử lý nhiều ngôn ngữ, nhưng hiệu quả phụ thuộc vào cách xây dựng và huấn luyện mô hình.

6.3. Những đối tượng nào nên áp dụng Seq2Seq?

NLP Engineer (Kỹ sư xử lý ngôn ngữ tự nhiên), Data Scientist (Nhà khoa học dữ liệu) Developer (Lập trình viên) / AI Engineer (Kỹ sư AI): Xây dựng chatbot, hệ thống dịch máy, ứng dụng tự động hóa. Doanh nghiệp công nghệ (Tech companies) ứng dụng AI vào dịch thuật, chăm sóc khách hàng, tóm tắt nội dung.

>>> Những bài viết liên quan:

Lời kết

Seq2Seq là một trong những mô hình nền tảng giúp máy tính hiểu và chuyển đổi chuỗi dữ liệu một cách linh hoạt và thông minh. Nhờ khả năng học ngữ cảnh và tạo ra chuỗi đầu ra tự nhiên, mô hình này đã trở thành giải pháp quan trọng trong nhiều bài toán AI như dịch máy, chatbot hay tóm tắt văn bản. Trong tương lai, seq2seq vẫn sẽ tiếp tục phát triển và đóng vai trò quan trọng trong các hệ thống xử lý ngôn ngữ hiện đại.

Phản ánh chất lượng dịch vụ:

Phản ánh chất lượng dịch vụ: